随着深度学习模型规模的不断增长,单机单卡的计算能力已难以满足千亿参数模型与海量数据训练的需求。

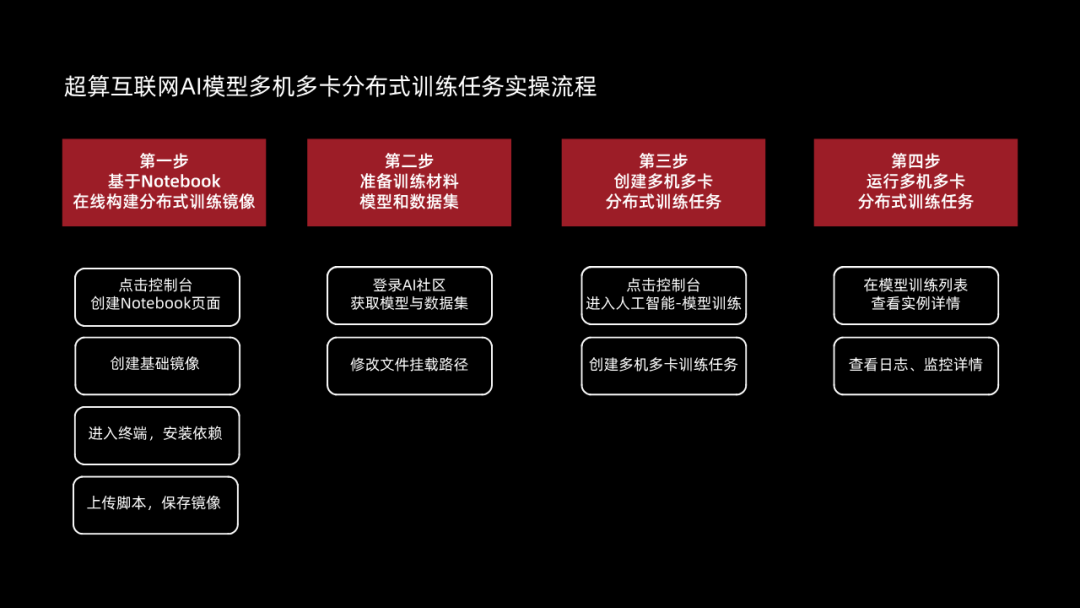

超算互联网现已上线多机多卡分布式训练模块,凭借其弹性扩展、资源高效利用与加速迭代的核心优势,成为解决海量计算与内存资源瓶颈的关键技术。

本次实操,我们以stable-diffusion-v1.4模型训练为例,演示如何在超算互联网提交多机多卡训练任务,开启分布式训练的高效之旅。

除了视频教程外,我们提供详细的实操文档,可参照这些步骤在超算互联网进行应用部署体验。

点击文末“阅读原文”或复制下方链接,访问使用教程文档:

https://www.scnet.cn/help/docs/mainsite/ai/model-training/practice/

相关新闻

-

2025-03-07

超算&AI应用周报 Vol.48 | 阿里QwQ-32B API接口服务、智谱文生图模型CogView4上线

-

2025-03-07

两会焦点|“超智融合”提案引关注,国家超算互联网再获肯定

-

2025-03-06

Lab已启动:你的AI实战主场来了

-

2025-03-04

论文解读Vol.1 | 生物学大模型ESM3登Science封面,可推理蛋白质序列、结构和功能

-

2025-03-03

超百家伙伴已加入,超算互联网“AI加速计划”引关注!

津公网安备12011602300273号

津公网安备12011602300273号

电子营业执照

电子营业执照

微信服务号

微信服务号