人工智能服务

>

最佳实践

>

Wan2.1-ComfyUI实操

如何轻松玩转AI视频?

阿里通义万相Wan2.1是首个具备支持中文文字生成能力,且同时支持中英文文字特效生成的视频生成模型。只需输入简短的文字描述,即可生成具有电影级效果的文字和动画。

在评测集VBench中,Wan2.1 的表现优于 OpenAI 的 Sora,VBench 排行榜评估视频生成质量的 16 个维度,包括主题身份一致性、运动平滑度、时间闪烁和空间关系等。

本次实操,我们演示如何在超算互联网启动Wan2.1-ComfyUI模型镜像,通过简单的节点工作流,执行文生视频t2v、图生视频i2v的pipeline,带你零门槛解锁AI视频,让文字、图片一键动起来。

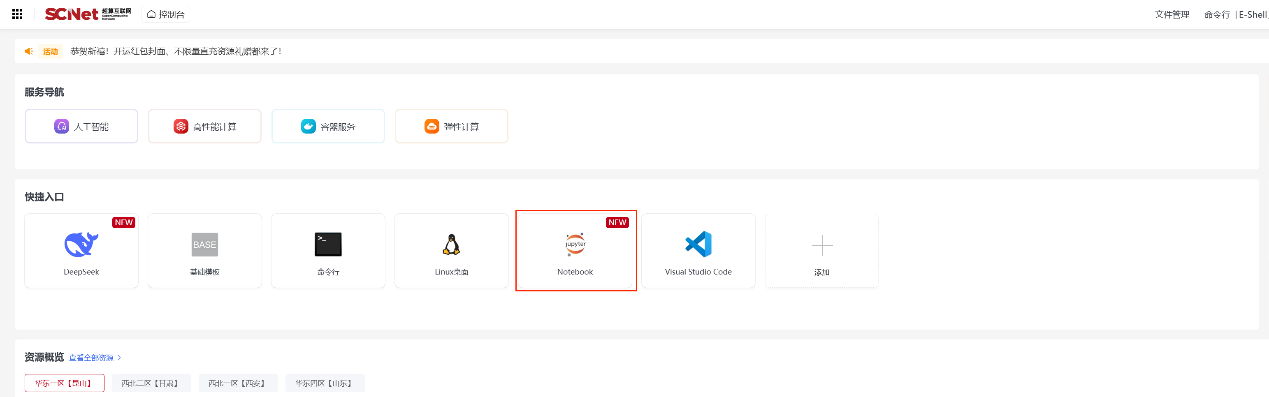

第一步:创建Notebook在线启动异构加速卡模型镜像

登录超算互联网https://www.scnet.cn个人账号,点击右上角“控制台”;

点击快捷入口中的“Notebook”,进入创建Notebook页面;

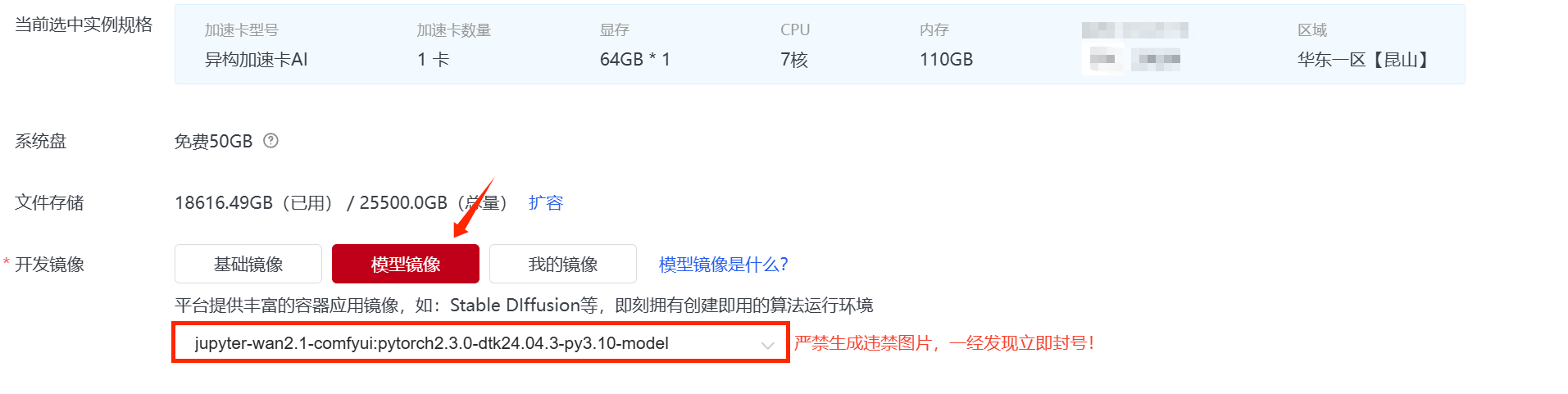

选择区域、选择1张异构加速卡AI-64GB,点击“模型镜像”,在列表中选择jupyter-wan2.1-comfyui点击创建;

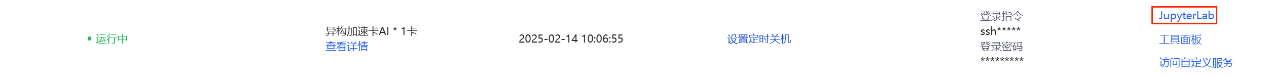

创建成功后,点击“JupyterLab”进入Notebook页面;

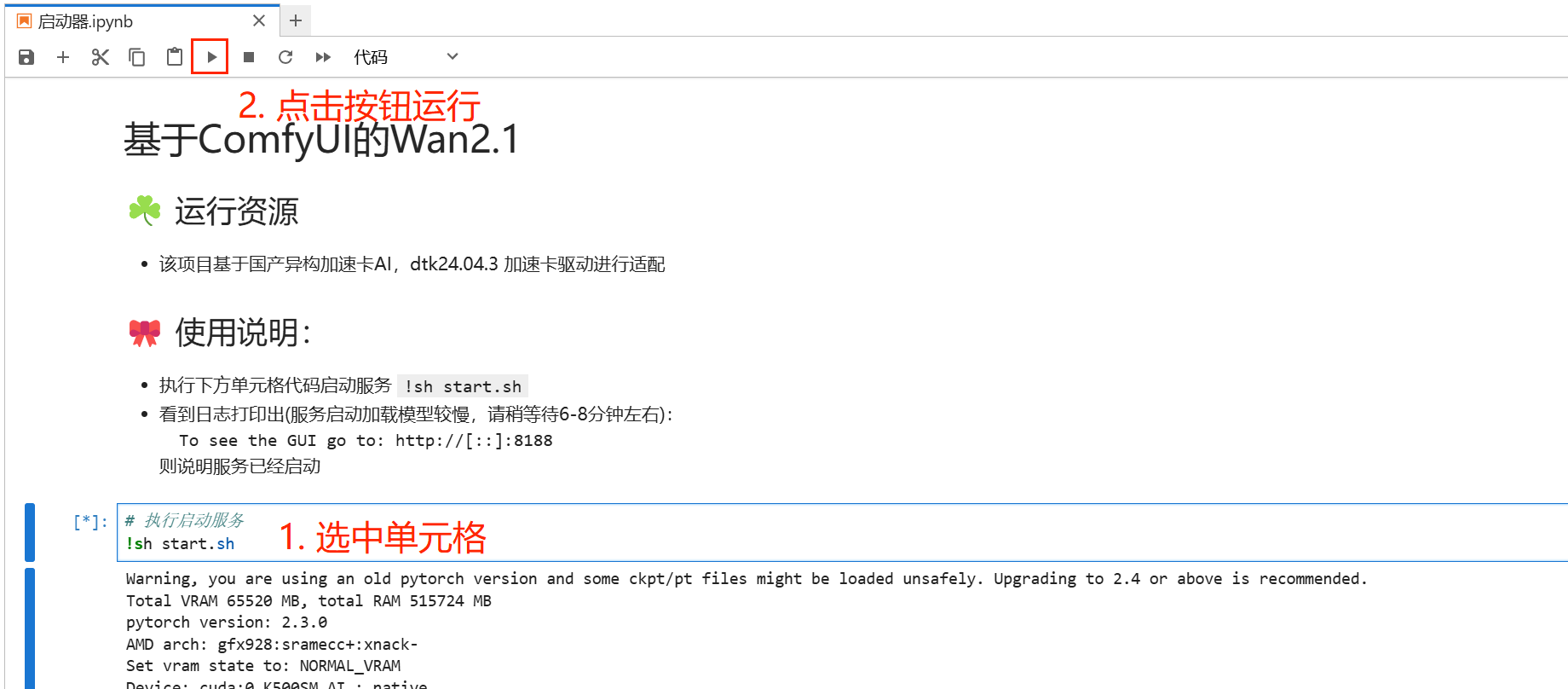

在Notebook中选中单元格,点击按钮运行代码,启动服务。

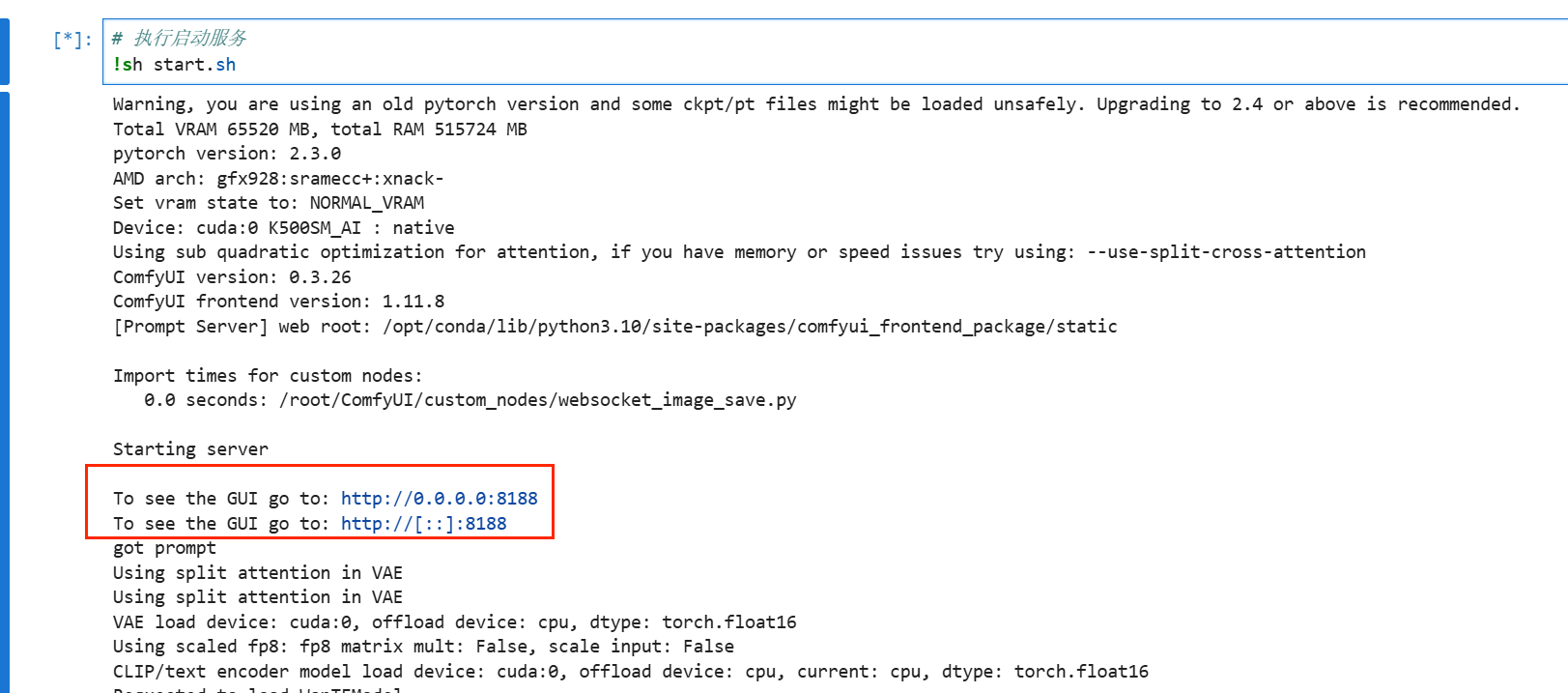

等待日志打印出端口号(服务启动会打印较多加载信息,请稍等待1~2分钟),则说明服务已经启动,复制端口号。

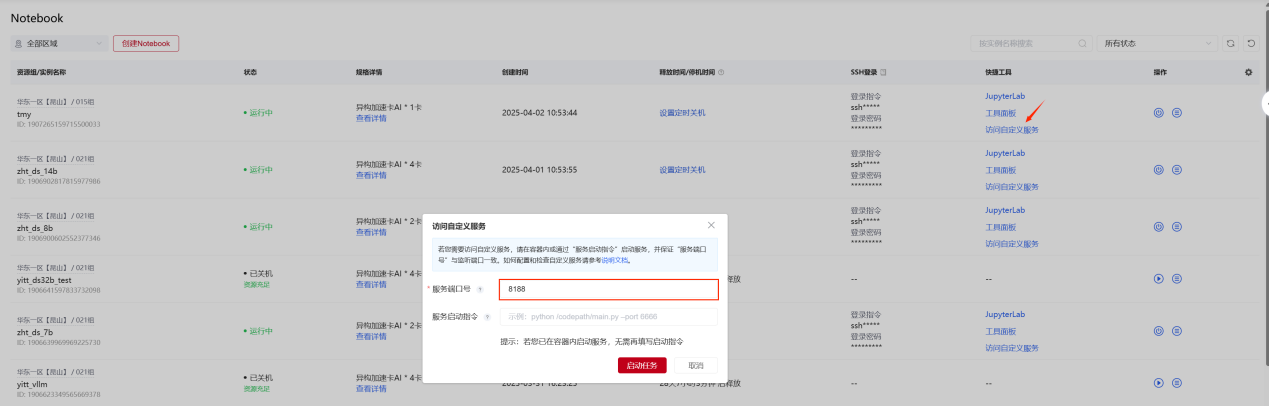

返回创建Notebook的页面点击“访问自定义服务”,并粘贴端口链接中的“端口号”,点击“启动任务”,即可进入wan2.1 comfyui界面。

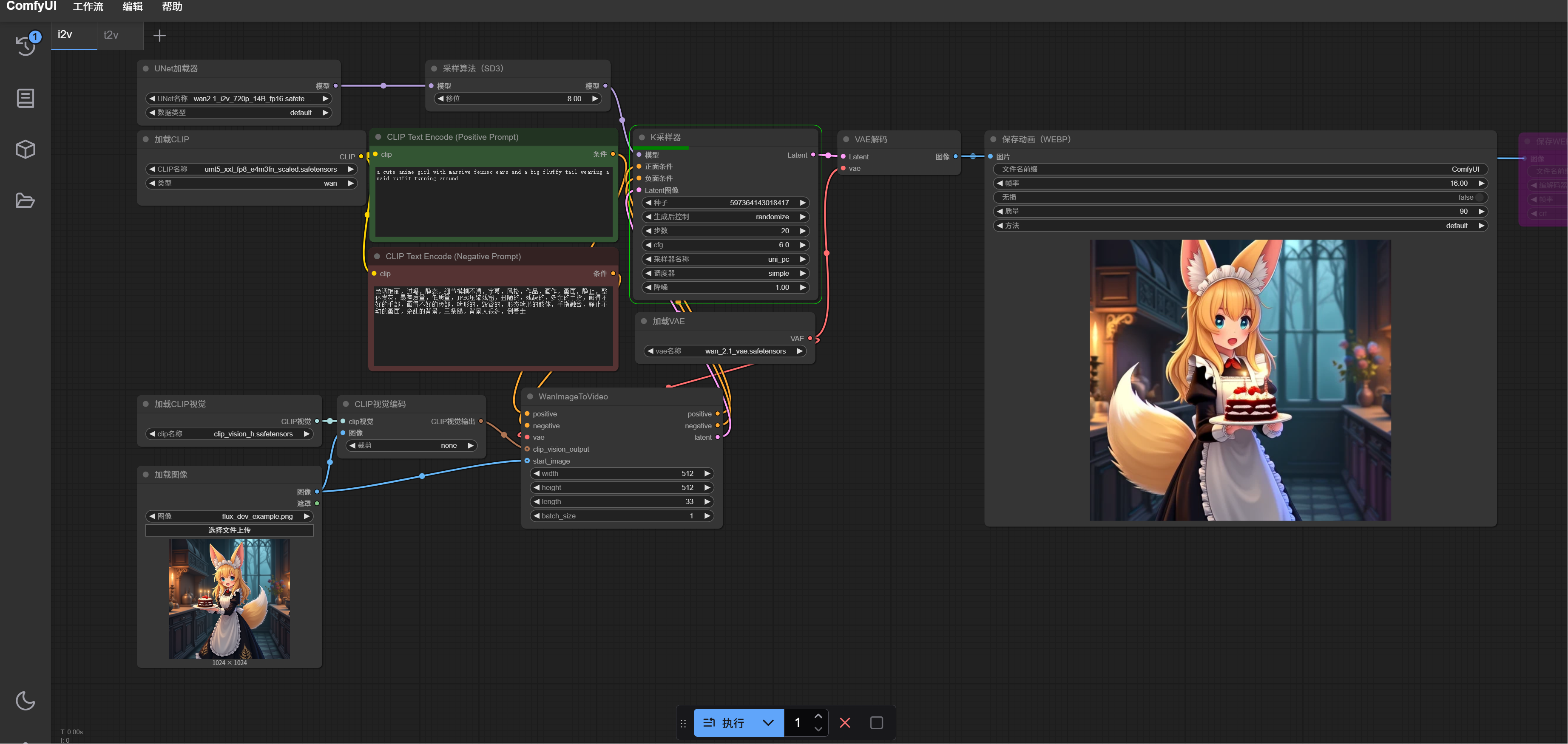

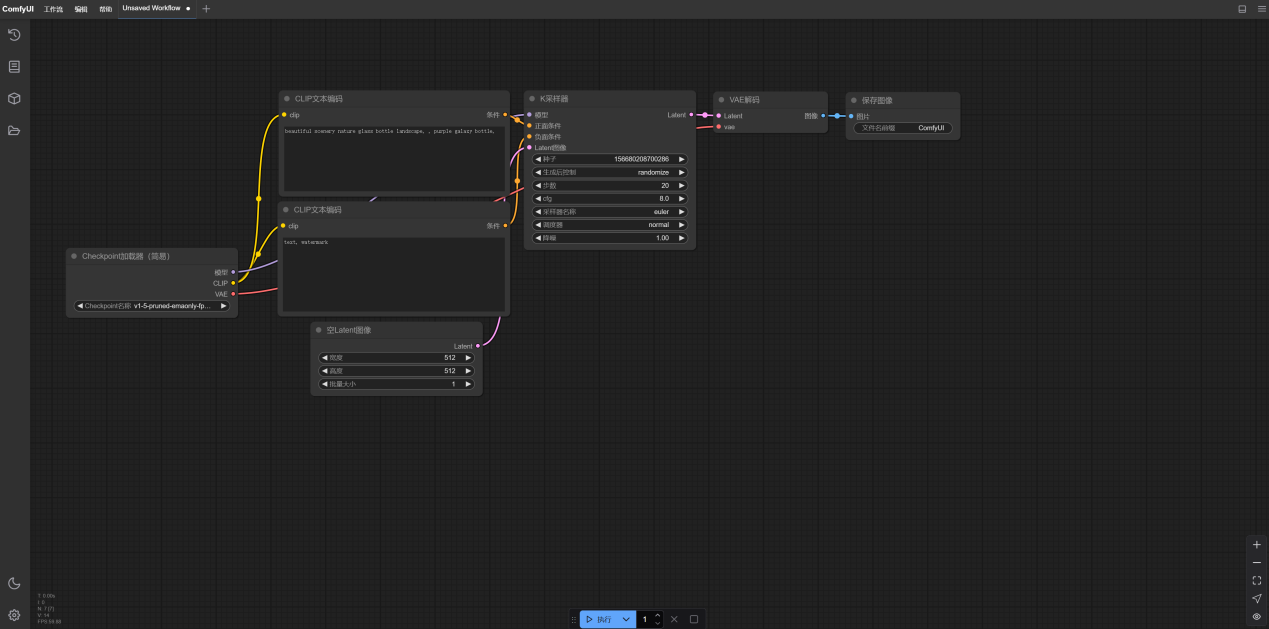

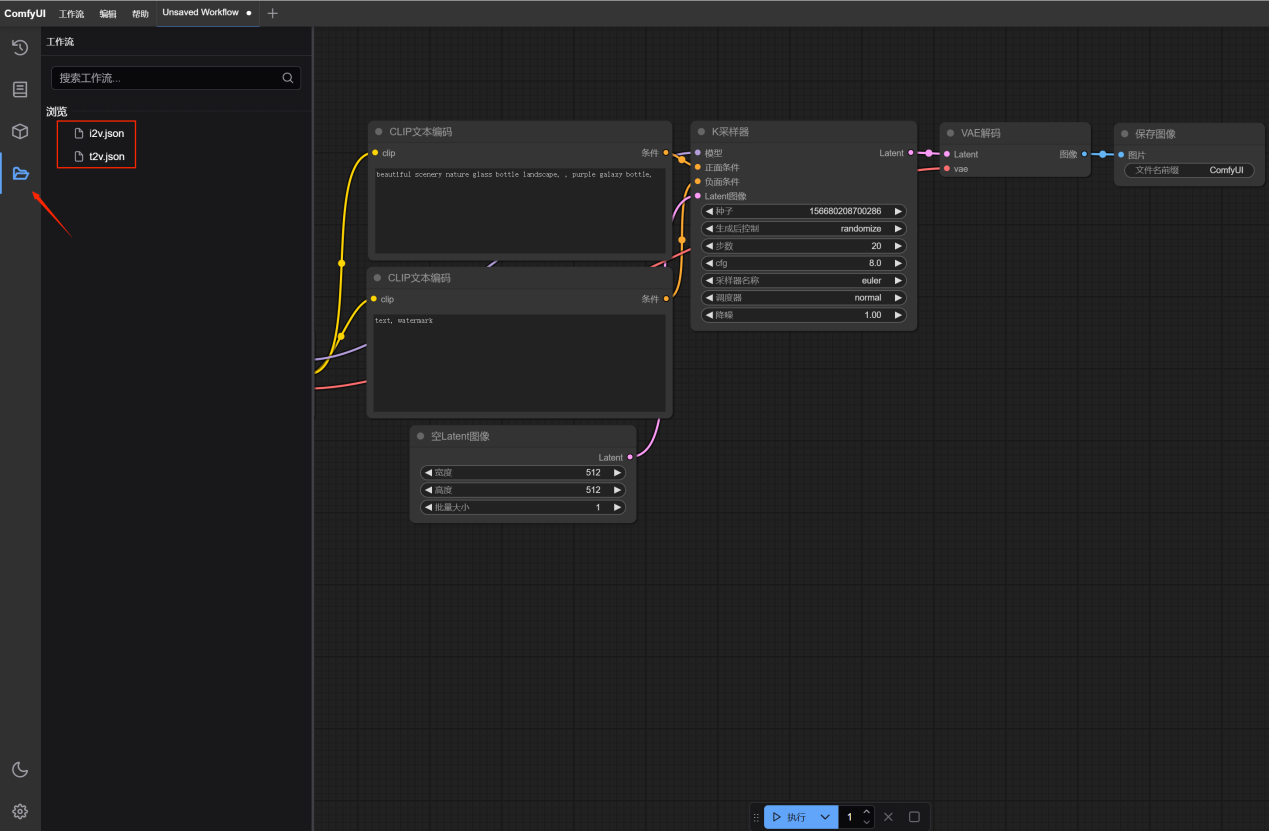

Wan2.1-comfyui界面:

我们的镜像中已经为大家准备好了两个基本的工作流,点击“工作流”按钮即可看到,一个是文生视频(t2v)另一个是图生视频(i2v),当然大家也可以自定义工作流。

(1)官方示例:点击t2v后,查看提示词,该提示词为英文。不做修改,直接点击执行。等待一段时间后,即可在右侧看到生成的视频效果。

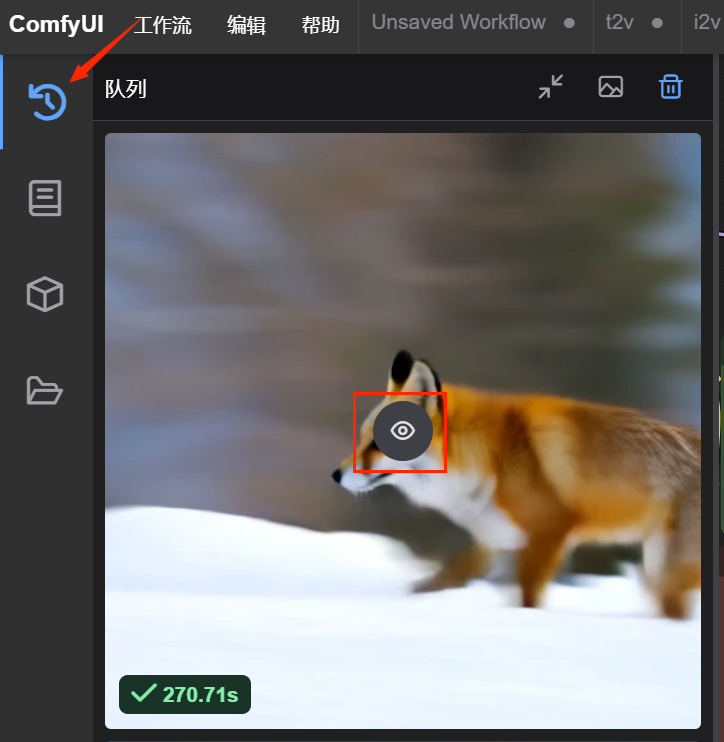

Prompt:a fox moving quickly in a beautiful winter scenery nature trees mountains daytime tracking camera(一只狐狸在美丽的冬季自然风光中快速移动,场景中有树木、山脉,白天使用追踪摄像机拍摄)

输出视频:

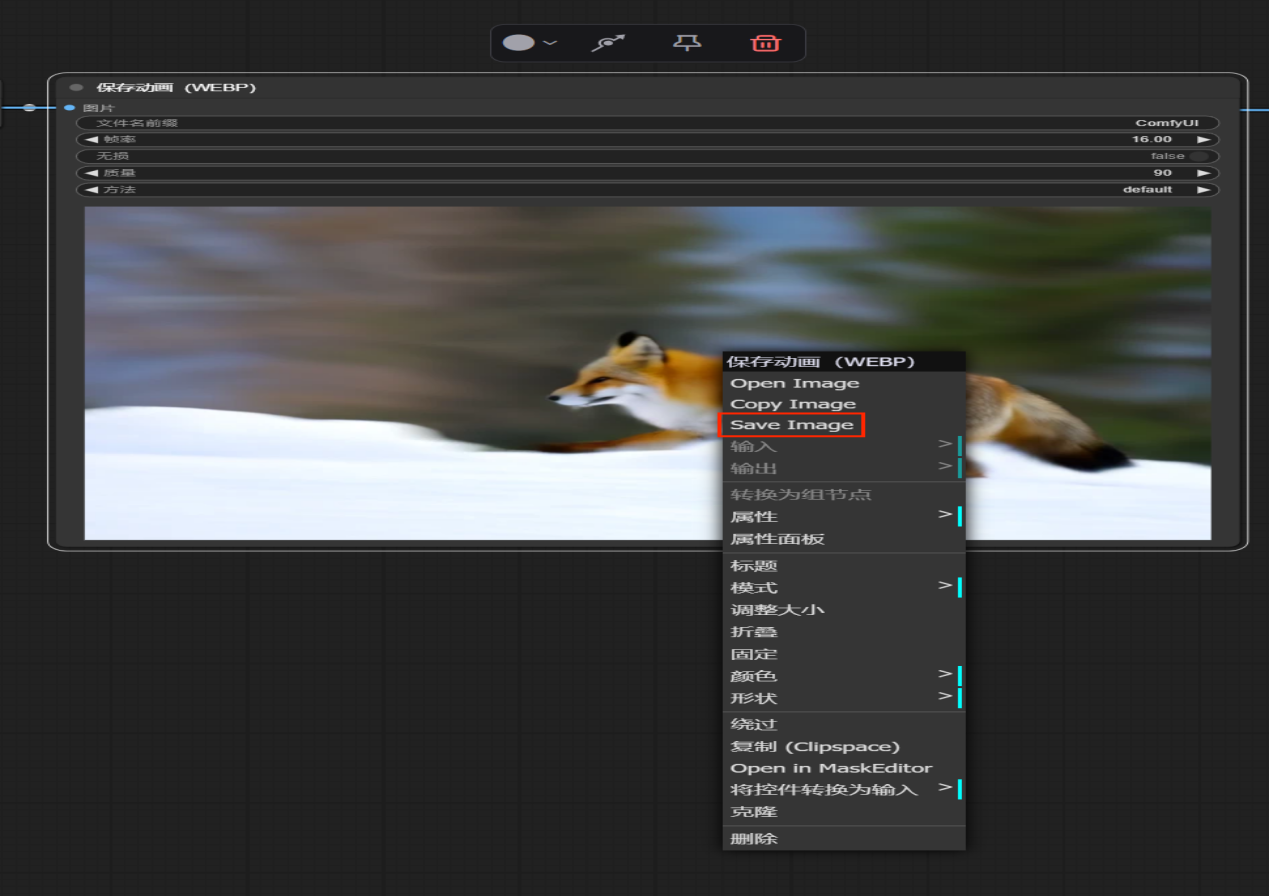

生成的视频还会保存在队列中,可以放大进行查看。

我们可以看到生成的效果还是非常不错的,如果觉得满意,可以在视频上右击,点击保存图片,将其保存在本地。

(2)自定义提示词:自定义中文提示词,点击执行,等待一段时间。

Prompt:一个古风美女,在花园中,悠然的散步。

输出视频:

(1)官方示例:点开基本的图生视频工作流,这个工作流中包含输入图片,默认的提示词也是英文的。不做修改,点击执行,等待一段时间。

输入图片:

Prompt:a cute anime girl with massive fennec ears and a big fluffy tail wearing a maid outfit turning around(一个可爱的动漫女孩有着巨大的耳廓狐耳朵和一条毛茸茸的大尾巴,穿着女仆装转身)

输出视频:

可以看到图片中的女孩按要求做出了转身的动作。

(2)中文支持:我们再使用这一张图片,将提示词翻译成中文试试,点击执行。 输入图片:同上

Prompt:一个可爱的动漫女孩有着巨大的耳廓狐耳朵和一条毛茸茸的大尾巴,穿着女仆装转身。

输出视频:

可以看到生成的视频中女孩在转圈的动作更加明显,同时还有镜头由远到近的效果,可看出模型对中文的支持还是比较不错的。

(3)自定义图片与提示词:我们更换别的图片试一试,点击“选择文件上传”,将本地的图片进行上传,这次上传的图片是一个静态的人物图,我们的提示词为中文,点击执行。

输入图片:

Prompt:一个穿着红色连衣裙的女人在沙漠中缓缓行走

输出视频:

可以看到图片中的人物动了起来,生成了想要的效果。

(4)动物图片:我们最后尝试一张动物图片,点击文件上传,这次上传的图片是一张皮卡丘的静态图。我们给的提示词是“皮卡丘欢快地大笑”。点击执行。

输入图片:

Prompt:皮卡丘欢快地大笑

输出视频:

可以看到图中的皮卡丘张开双手进行开怀大笑,与此同时,wan2.1还给皮卡丘张开的手掌加上了黑色的肉垫,这个细节非常不错。

以上就是关于Wan2.1-ComfyUI的一些实测效果,希望本篇最佳实践为您提供一些有价值的信息和实践技巧。